В предстоящей статье «Это выглядит сексуально, но это неправильно: напряжённость между творчеством и точностью при использовании GenAI в биомедицинской визуализации», которая будет представлена на конференции IEEE Vis 2025, специалисты по визуализации призывают к немедленной разработке этических и методологических стандартов. Пока же, говорят они, мы находимся на грани кризиса доверия к научным иллюстрациям.

Красиво, но неверно: иллюзия точности

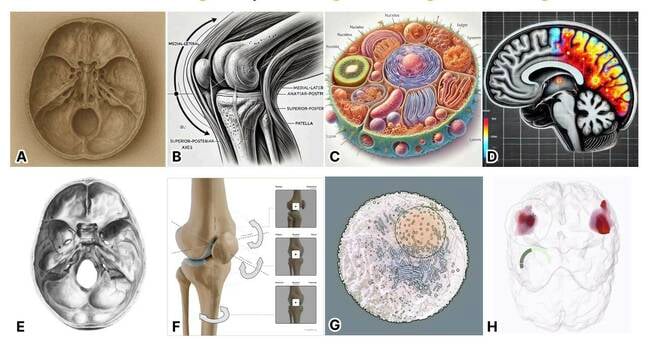

Современные модели, такие как GPT-4o и DALL-E 3, способны генерировать изображения, которые выглядят профессионально, детализированно и убедительно. Однако за этой внешней полировкой часто скрывается полное отсутствие анатомической точности.

«Визуальные эффекты, созданные ИИ, могут выглядеть настолько надёжно, что их принимают за достоверные источники информации, — пишут авторы. — Эта иллюзия точности опасна».

Опасность в том, что:

- Пациенты могут принимать решения на основе визуализаций, сгенерированных ИИ,

- Врачи — использовать неточные изображения в диагностике или обучении,

- Научные публикации — включать фантастические иллюстрации как будто бы реальные данные.

Примеры: от «хорошо одаренной крысы» до «инопланетных яиц»

Одним из самых громких случаев стала отозванная статья в журнале Frontiers in Cell and Developmental Biology, где в качестве иллюстраций использовались изображения, созданные ИИ. На них — крысы с анатомически невозможными анатомическими особенностями. Случай получил прозвище «печально известная хорошо одаренная крыса» и стал поводом для сатиры даже в «Позднем шоу со Стивеном Колбертом».

«Подумайте, — говорит соавтор исследования Роксана Зиман, — что происходит, когда такие случаи становятся поводом для насмешек. Это не просто смешно — это подрывает доверие к науке. Если общество начинает сомневаться в научных иллюстрациях, как оно будет воспринимать кампании по вакцинации, борьбу с пандемиями или климатическим кризисом?»

Другой пример — реакция на запрос «поджелудочная железа» в MidJourney:

«Вот ваша куча инопланетных яиц!» — с горечью замечает эксперт Урсула, одна из участниц опроса.

Где ИИ может быть полезен — и где он опасен

Авторы опросили 17 специалистов по биомедицинской визуализации (BioMedVis), чтобы понять, как они относятся к GenAI. Выяснилось: отношение резко поляризовано. Участников можно было разделить на пять типов:

- «Восторженные последователи» — видят в ИИ революцию,

- «Любопытные адаптеры» — пробуют, но с осторожностью,

- «Любопытные оптимисты» — верят в потенциал,

- «Осторожные оптимисты» — используют, но только для черновиков,

- «Скептически избегающие» — отказываются категорически.

Некоторые отметили, что ИИ помогает в творческих задачах: создании концептов, абстрактных визуализаций, эстетически привлекательных презентаций. Другие критикуют его за однообразный, «скучный» стиль и отсутствие научной глубины.

Технология не знает анатомии… и не пытается узнать

Одна из главных проблем — ИИ не понимает, что он рисует. Он не отличает седалищный нерв от локтевого. Он не знает, что поджелудочная железа — это не «светящийся улей». Он просто смешивает визуальные паттерны из обучающих данных, включая научные иллюстрации, художественные интерпретации и фантастику.

«Он просто видит провода», — говорит Артур, участник опроса. — «И рисует провода».

При этом ИИ галлюцинирует термины: «зелёный светящийся белок» вместо зелёного флуоресцентного белка (GFP) — классический пример.

Кто виноват, если ИИ ошибся?

Ещё один острый вопрос — ответственность.

- Если врач использует ИИ-изображение в диагностике, а оно ошибочно — кто виноват?

- Если научная статья публикует фальшивую визуализацию — редакция, автор или разработчик ИИ?

- Кто несёт ответ за предвзятость в данных, если ИИ обучался на изображениях, где представлены только светлокожие мужчины?

«Должен быть кто-то, кто может объяснить результат, — говорит участник опроса Ким. — Речь идёт о доверии и компетентности».

Но современные модели — это «чёрные ящики». Никто не может гарантировать, откуда взялась конкретная деталь на изображении.

Размытие границ: от кода до этики

ИИ используется не только для картинок. Многие специалисты применяют его для:

- Генерации шаблонного кода,

- Очистки данных,

- Написания подписей и описаний.

Но и здесь есть риск ошибок, галлюцинаций и потери контроля. При этом, как отмечают исследователи, многие из тех же специалистов, которые критикуют ИИ за нарушение авторских прав, активно используют его в личных проектах — и даже в коммерческих.

Что делать?

Авторы не предлагают запрещать ИИ. Они призывают к открытому, честному и критическому диалогу в научном и медицинском сообществе.

«Мы должны чувствовать себя комфортно, делясь своими мыслями, вопросами и опасениями, — говорит Шехрияр Сахаран из Университета Торонто. — Без размышлений мы рискуем использовать технологии так, как будто они нас, а не мы их».

Они предлагают:

- Разработать стандарты маркировки ИИ-генерируемых изображений,

- Ввести обязательные проверки точности в научных журналах,

- Создать обучающие модули по этике и критическому мышлению в эпоху ИИ,

- Установить четкие границы ответственности.

Биомедицинская визуализация — это не искусство. Это инструмент понимания, диагностики и обучения. Красивая картинка, которая лжёт, опаснее, чем чёрно-белый набросок, который правдив.

«GenAI в его нынешнем состоянии не может достичь стандарта точности, необходимого для научной и медицинской работы», — делают вывод авторы.

Пока ИИ учится различать нервы, учёные должны учиться не доверять тому, что выглядит слишком хорошо, чтобы быть правдой.

Источник: https://www.theregister.com/2025/07/27/biomedviz_ai_wrong_problems/Если вам понравился материал, кликните значок - вы поможете нам узнать, каким статьям и новостям следует отдавать предпочтение. Если вы хотите обсудить материал - не стесняйтесь оставлять свои комментарии : возможно, они будут полезны другим нашим читателям!