Работа опубликована в журнале BMJ Health and Care Informatics и уже рассматривается как один из наиболее перспективных векторов развития медицинского ИИ.

Проблема: избыточная самоуверенность машин

Современные системы ИИ часто функционируют как «чёрные ящики», выдавая рекомендации с высокой степенью уверенности — даже в случаях, когда данные неоднозначны или неполны.

По словам Leo Anthony Celi, это создаёт опасную динамику:

- врачи склонны доверять системе, воспринимая её как авторитет;

- даже при сомнениях клиницисты могут следовать рекомендациям ИИ;

- ошибки усиливаются эффектом «автоматического авторитета».

Новый подход: ИИ как партнёр, а не оракул

Команда MIT предлагает сменить парадигму: от ИИ-«оракула» к ИИ-«второму пилоту».

Ключевая идея — внедрение механизмов саморефлексии, позволяющих системе:

- оценивать собственную уверенность,

- сопоставлять её с качеством входных данных,

- сигнализировать о неопределённости,

- запрашивать дополнительные данные или консультации.

«Скромный» ИИ не просто даёт ответ — он указывает, насколько этому ответу можно доверять.

Как это реализовано

Фреймворк включает несколько модулей, которые можно интегрировать в существующие модели:

1. Эпистемическая самооценка

Модель анализирует уровень своей уверенности и корректирует его в зависимости от сложности клинического случая.

2. Обнаружение несоответствий

Если уверенность превышает доступные доказательства, система:

- приостанавливает вывод,

- отмечает риск ошибки,

- предлагает дополнительные тесты или сбор анамнеза.

3. Поддержка коллективного мышления

ИИ стимулирует врача к переоценке ситуации, а не подменяет его решение.

Разработкой отдельных компонентов занимались, в частности, исследователи из University of Melbourne.

Данные как источник риска

Отдельное внимание уделяется качеству обучающих данных. Многие системы строятся на базах вроде MIMIC (Medical Information Mart for Intensive Care), созданных на основе американских медицинских записей.

Это приводит к ряду проблем:

- ограниченная репрезентативность (например, недоучёт сельских пациентов),

- отсутствие контекста в данных,

- риск воспроизведения системных неравенств.

По словам Sebastián Andrés Cajas Ordóñez, разработчики должны критически оценивать сами данные, а не только алгоритмы.

От индивидуального ИИ к коллективному

Проект реализуется в рамках консорциума MIT Critical Data, который объединяет:

- врачей,

- дата-сайентистов,

- социальных исследователей,

- пациентов.

Цель — создать ИИ, учитывающий множественные точки зрения и минимизирующий скрытые предвзятости.

Практическое применение

Подход уже тестируется:

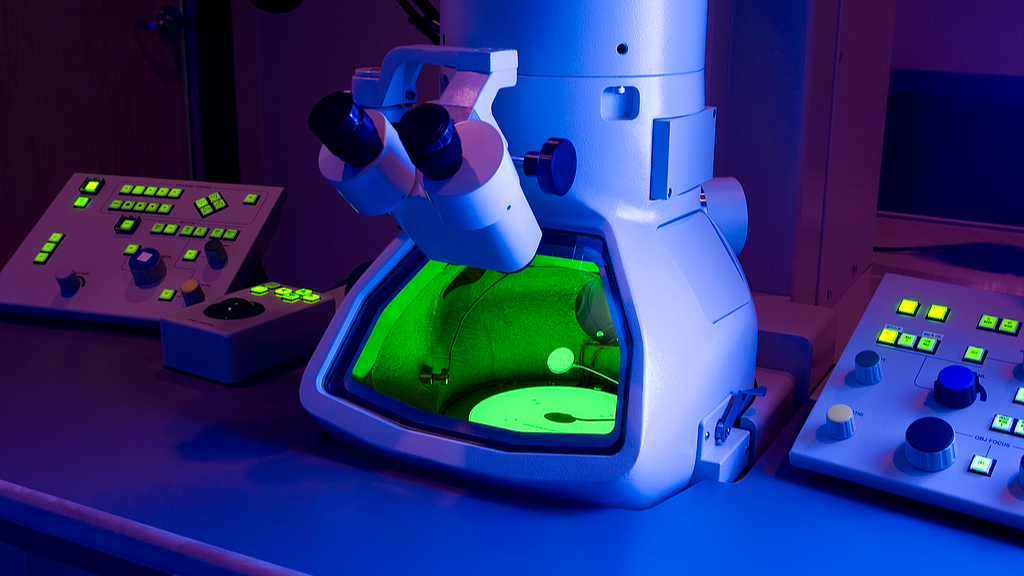

- в системах интенсивной терапии,

- при анализе медицинских изображений,

- в поддержке решений в отделениях неотложной помощи.

В перспективе такие системы могут стать стандартом в клинической практике.

Почему это важно

В эпоху стремительного внедрения ИИ ключевым становится не только точность моделей, но и их поведение в условиях неопределённости.

«Скромный» ИИ:

- снижает риск критических ошибок,

- усиливает роль врача, а не заменяет её,

- делает принятие решений более прозрачным.

Фактически речь идёт о переходе от автоматизации решений к усилению человеческого мышления — что может стать основой безопасного внедрения ИИ не только в медицине, но и в других высокорисковых отраслях.

Источник: https://news.mit.edu/2026/creating-humble-ai-0324Если вам понравился материал, кликните значок — вы поможете нам узнать, каким статьям и новостям следует отдавать предпочтение. Если вы хотите обсудить материал —не стесняйтесь оставлять свои комментарии : возможно, они будут полезны другим нашим читателям!