Введение

Всё большее распространение получают мультиспектральные видеосистемы, которые формируют комбинированное видеоизображение, содержащее информационные признаки от используемых разноспектральных каналов. Такие системы могут применяться для оптико-электронной разведки, для повышения осведомлённости экипажей мобильной техники, включая авиационную технику, при управлении в сложных погодных и суточных условиях. Достаточно широкую известность получили авиационные системы улучшенного видения (СУВ) для повышения информированности экипажей гражданских самолётов при пилотировании на наиболее ответственных участках [1].

Разработка мультиспектральной видеосистемы основана на использовании серийно выпускаемых комплектующих, включая оптику, что существенно повышает надёжность, предсказуемость работы и снижает стоимость разработки. Но применение серийно выпускаемой техники приводит к ряду технических трудностей:

- рассогласование полей зрения видеоканалов из-за разных матриц и объективов;

- параллакс видеокамер системы, образующих между собой стереопары;

- необходимость юстировки оптических осей системы для достижения их параллельности;

- разное тепловыделение и теплопроводность разных датчиков могут приводить видеосистему к неравномерному нагреву и, как следствие, к неравномерной засветке видеоизображений в ИК-диапазоне;

- проблема выбора алгоритма и приоритета комплексирования видеоканалов из-за сложности формализации понятия «информативность изображения» и проведения её количественной оценки, согласованной с визуальным восприятием.

Далее произведён разбор указанных проблем и вопросов, в котором рассматриваются методики и алгоритмы их эффективного разрешения на примере трёхспектральной видеосистемы.

Конструктив мультиспектральной системы

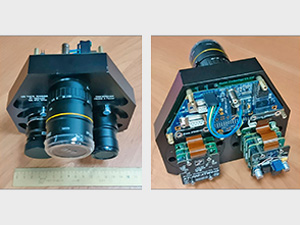

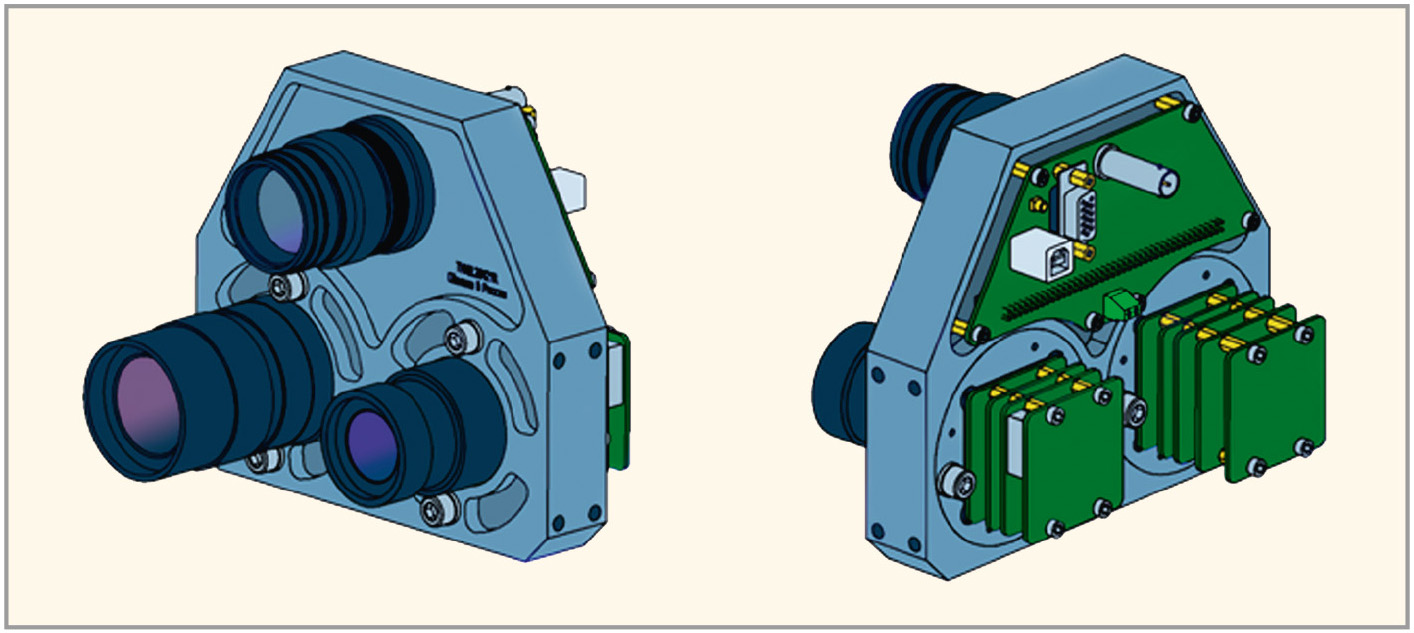

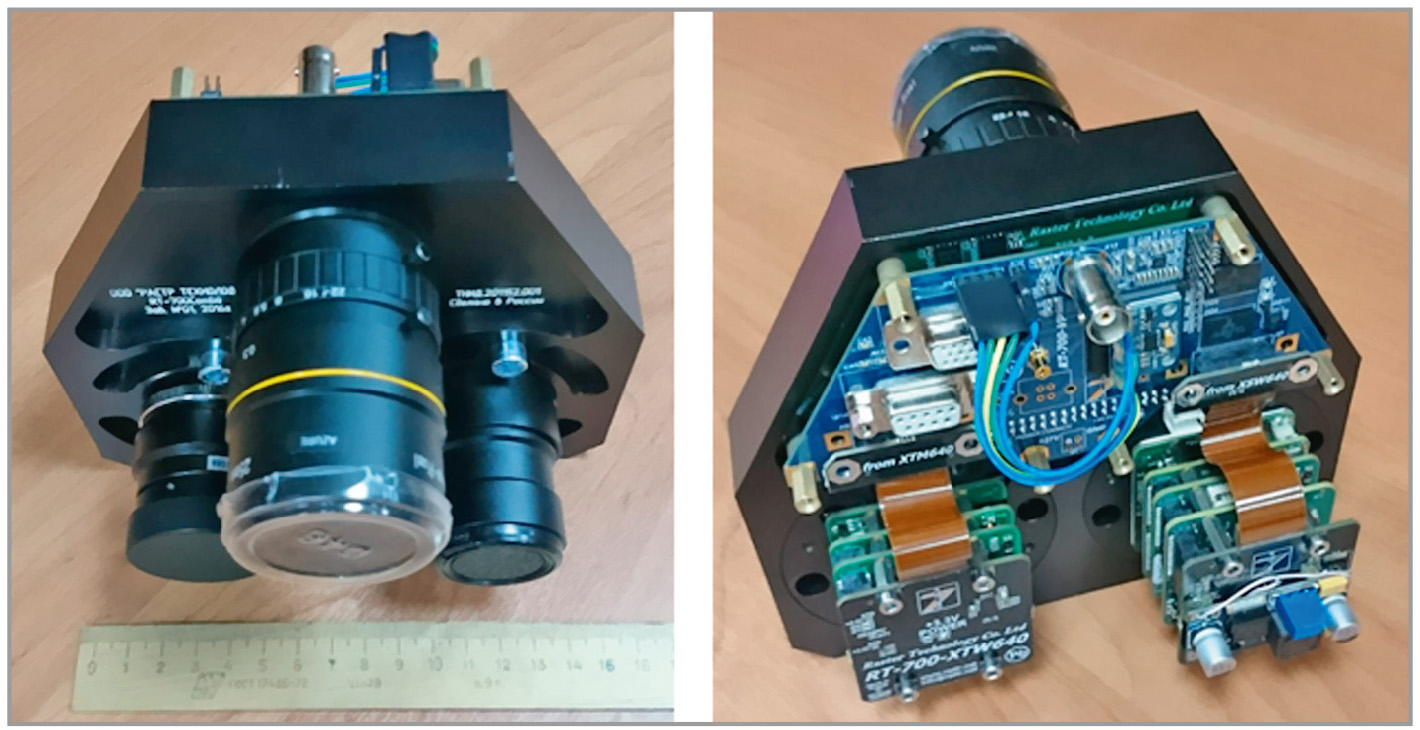

Предлагаемый конструктив без внешнего корпуса для трёхспектральной системы (ТВ, ближний и дальний ИК-каналы) представлен на рисунке 1.

Достижение приемлемой параллельности оптических осей достигается за счёт разработки единой платы фотоприёмников, куда вставляются видеоматрицы или видеомодули. Позиционирование видеокамер в готовых штатных корпусах представляется менее точным. Конструктивно предусмотрена юстировка двух нижних тепловизионных модулей по крену.

Проблема неравномерного нагрева изделия решается изготовлением внутреннего корпуса-радиатора, плотно прилегающего к каждому из видеомодулей, служащего одновременно конструкцией для крепления объективов (см. рис. 1).

Минимизация параллакса между датчиками данной видеосистемы достигается за счёт расположения геометрических центров матриц и объективов соответственно в вершинах правильного треугольника с минимально допустимым конструктивом сторон. Видеоизображения и питание планируется передавать по единому кабелю, работающему по интерфейсу CoaXPress, что существенно повысит эргономику и надёжность системы.

Совмещение изображений в мультиспектральной системе

Совмещение видеоизображений может производиться как на аппаратном (вариофокальная оптика), так и на программном уровне (обработка изображений). Однако приобретение вариофокальной оптики существенно повысит конечную стоимость системы, не говоря уже об изготовлении на заказ видеоматриц с желаемым форматом и размерами элементов. К тому же вариофокальные объективы имеют меньшую светосилу и превосходят по массе и габаритам объективы с фиксированными фокусами.

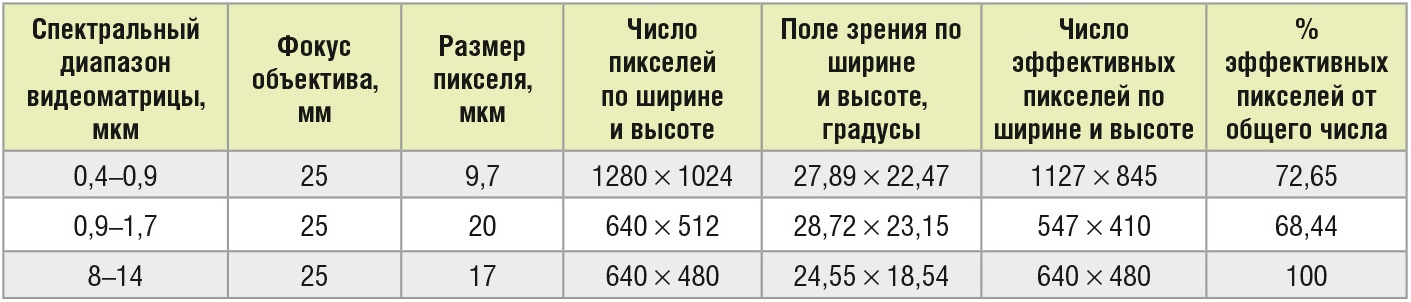

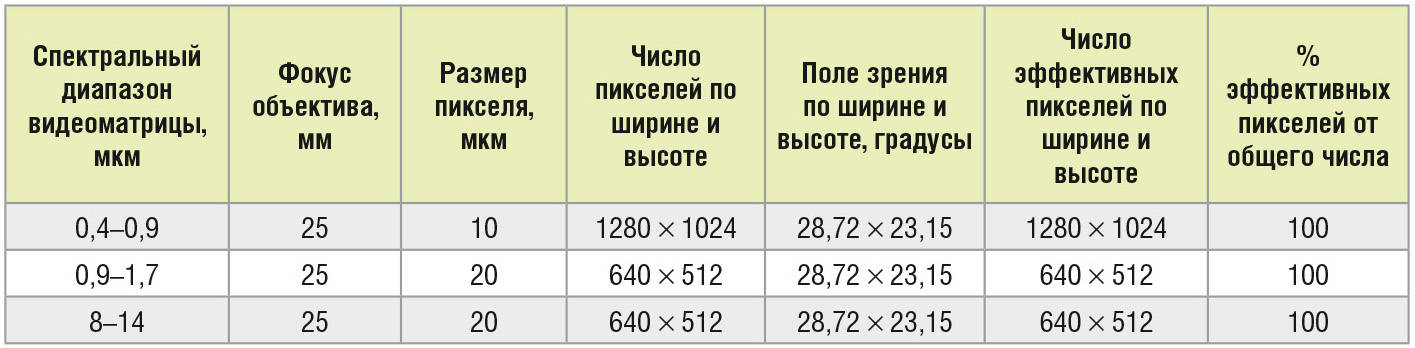

В таблице 1 приведены реальные параметры трёхспектральной системы, разрабатываемой фирмой ООО «РАСТР ТЕХНОЛОДЖИ».

В таблице 2 приведён оптимальный (желаемый) вариант по видеоматрицам, который не удалось найти, когда физические размеры их пикселей обратно пропорциональны разрешению видеоматриц.

В реальности процент эффективных пикселей комбинированного изображения всегда будет ниже 100%, так как видеоматрицы конструктивно не могут быть расположены в одном месте, что делает процедуру совмещения видеоизображений неотъемлемой частью алгоритмического обеспечения мультиспектральной видеосистемы.

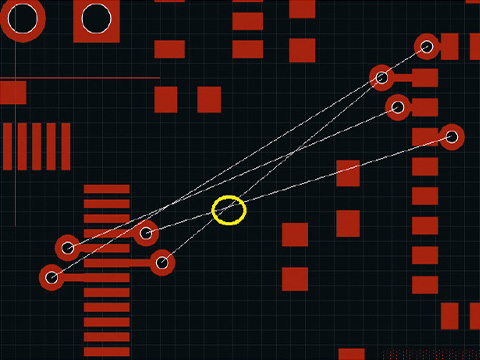

Эффективным представляется программное совмещение видеоизображений с использованием методов компьютерной графики, основанное на наложении текстур видеоизображений на картинный полигон, размеры которого кратны размерам формируемого кадра. Совмещение достигается путём увеличения с интерполяцией и сдвига текстур на этом полигоне через изменение их текстурных координат так, чтобы объекты на комбинированном изображении не двоились.

Адаптивный алгоритм комплексирования изображений

Комплексирование изображений полезно только при наличии существенной информации в двух и более видеоканалах. Если же вычисленный приоритет одного канала существенно ниже остальных, то его информационные признаки не будут заметно различимы на комбинированном изображении. Поэтому нужно уметь количественно оценивать их информативность.

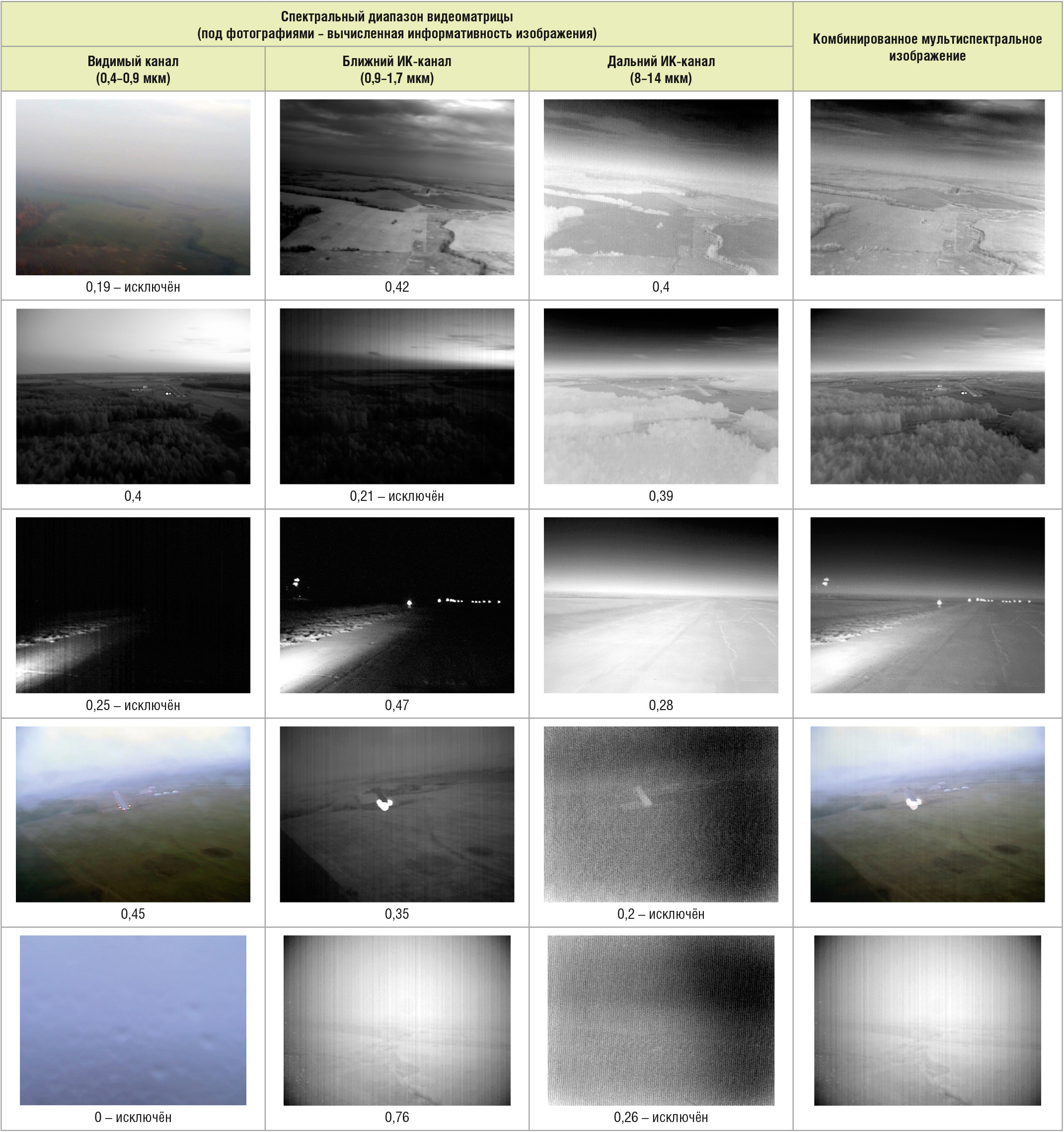

Согласно исследованию [2], к существенным информационным признакам изображений относятся воспринимаемые детали (пространственные признаки), представляющие собой протяжённые перепады яркости, и спектральные контрасты или спектрально-энергетические признаки. Таким образом, безэталонную оценку информационных признаков изображения можно свести к оценке протяжённых перепадов его яркости. Для оценки приоритета видеоканалов вычисляют информативность изображений на основе анализа присутствующих перепадов яркости и её, информативность, нормируют [3]. Результаты работы предлагаемого алгоритма автоматического выбора и комплексирования видеоканалов в различных условиях показаны в таблице 3.

Практика предыдущих лётных испытаний, проводимых ФГУП «ГосНИИАС», показала, что комплексирование всех трёх видеоканалов избыточно, поэтому наименее информативный канал просто исключается из рассмотрения, для остальных же двух вводится адаптивное условие их использования [3].

Если выбрано два информативных видеоканала, то необходимо осуществить их комплексирование. Наиболее перспективными представляются подходы на основе метода трёхмерной фильтрации [4], восстанавливающего многомерное сообщение по его отсчётам по элементам изображений и источникам их формирования. Область пропускания такого фильтра нижних частот (ФНЧ) рассчитана исходя из общих свойств источника (мультиспектральной системы улучшенного виденья, МСУВ) и получателя (оператора) многомерных видеоизображений. Совместная работа [5] продемонстрировала эффективную аппаратную реализацию трёхмерного ФНЧ на ПЛИС в видеопроцессоре для обработки движущихся изображений в реальном времени.

Особенности аппаратной реализации МСУВ

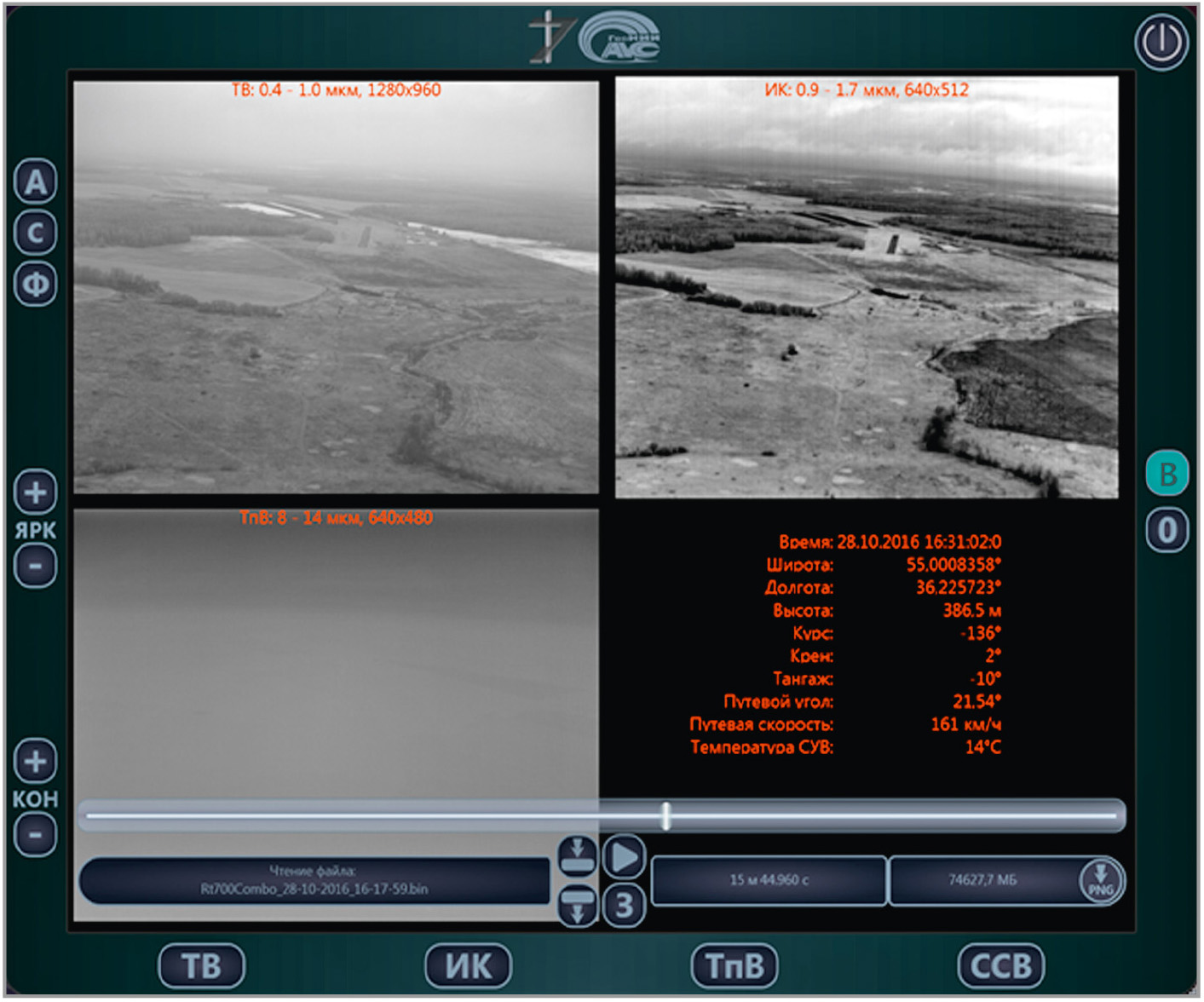

В состав реализованной МСУВ RT-700Combo входят три видеоканала: видимый (0,4–1,0 мкм, 1280 × 960 (эффективные пиксели)), ближний инфракрасный (0,9–1,7 мкм, 640 ×

× 512) и тепловизионный (8–14 мкм, 640 × 480), а также навигационная система, измеряющая положение и ориентацию МСУВ в пространстве. Показания навигационной системы будут использованы для оценки разрешающей способности видеоканалов на местности на тест-объектах. Все данные передаются по интерфейсу CoaXPress через интерфейсную плату RT-650CXP (поставляется в комплекте с RT-700Combo) с частотой 25 Гц. Встроенный спутниковый приёмник измеряет также путевые скорость, угол и время. Имеется датчик температуры изделия. Запись видео и навигации производится с частотой в 25 Гц в несжатом бинарном формате.

К моменту написания данного материала успешно прошли первые лётные испытания МСУВ RT-700Combo совместной разработки с ФГУП «ГосНИИАС» для информационной поддержки экипажей летательных аппаратов при заходе на посадку в сложных метеоусловиях.

На рисунке 2 представлены фотографии RT-700Combo без внешнего корпуса. На рисунке 3 представлены фотографии изделия во внешнем теплоизолированном корпусе со специальными защитными стёклами. Отладочный внешний корпус изготовлен и установлен сотрудниками ФГУП «ГосНИИАС» на самолёт Cessna (см. рис. 4 и 5).

Текущая реализация является пока макетной разработкой, так как в собранной установке используется персональный компьютер (ПК) бытового исполнения с автономным питанием от аккумуляторов через преобразователь напряжения (инвертор). Для обеспечения ЭМС (иначе видеосигнал идёт с рывками и задержками) пришлось как можно дальше разносить кабель питания и коаксиальный кабель, делать заземление инвертора на корпус самолёта и экранировать питание системного блока ПК.

Вывод видео и навигационных данных с частотой в 25 Гц осуществлялся на портативный видеомонитор с разрешением 1360 × 768 в кабине самолёта (см. рис. 6).

Функции обработки изображений от видеоканалов реализованы на видеокарте с использованием DirectX 9 и шейдеров на HLSL. Полностью векторный интерфейс ПО МСУВ написан c использованием библиотеки WPF 4.0, является аппаратно-независимым с поддержкой плавных градиентов, полупрозрачности элементов управления и их многослойности. Режим видеорегистратора ПО МСУВ позволяет записывать и воспроизводить видеопоследовательности с сопутствующими навигационными данными в бинарном несжатом формате (см. рис. 7). Кнопка «PNG» позволяет переводить выбранную часть записанных видеоданных в изображения широко распространённого формата PNG (Portable Network Graphics) для их дальнейшего исследования с глубиной оцифровки 8 бит на пиксель. В МСУВ предусмотрена также оцифровка видеоданных 16 бит на пиксель, однако для человеко-машинных систем она представляется избыточной.

В примере на рисунке 7 видеосъёмка RT-700Combo проводилась 28 октября 2016 г. в 16:30 в Калужской области на аэродроме Кудиново при температуре воздуха +1°C и относительной влажности 100%. В этих условиях тепловизионный канал (на рисунке 7 слева внизу) неинформативен.

Особенности программной части МСУВ

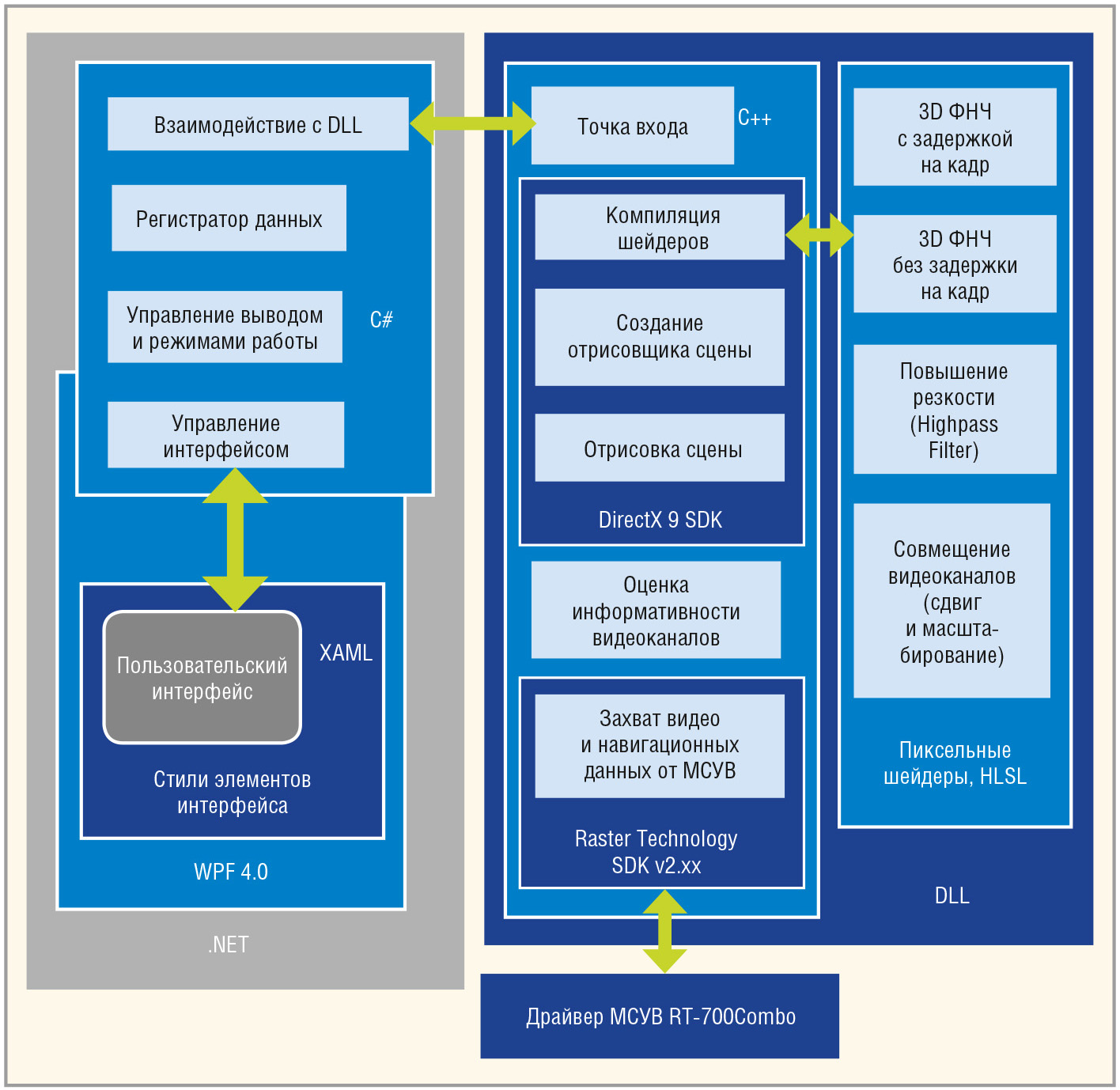

Основная идея разработанного ПО МСУВ заключается в обработке изображений на видеокарте, что позволяет успевать обрабатывать их с частотой в 25 Гц. Обработка изображений-текстур на базе графической библиотеки позволяет также производить эффективное аппаратно-независимое совмещение видеоканалов. Первоначально планировалось сделать почти всю обработку аппаратно на ПЛИС, однако при разработке и изготовлении системы в сжатые сроки (8 месяцев) в условиях урезанного финансирования это не удалось реализовать. На данный момент некоторые алгоритмы и их аппаратная реализация недостаточно отработаны, поэтому сложно оценить необходимые аппаратные ресурсы. Архитектура ПО МСУВ представлена на рисунке 8.

ПО разработано для 32- и 64-битных ОС Windows (Vista, 7, 8, 10), так как драйверы аппаратуры МСУВ написаны для этих ОС. К тому же это одна из самых распространённых ОС в мире: в настоящее время установлена примерно на 90% персональных компьютеров и рабочих станций.

В качестве базовой платформы была выбрана программная платформа .NET Framework версии 4.0. К настоящему моменту вышла более новая версия 4.6.2 [6], однако используемых возможностей версии 4.0 пока более чем хватает. Выбор платформы обоснован удобством и гибкостью разработки пользовательских интерфейсов в системе для построения клиентских приложений WPF (Windows Presentation Foundation), что позволяет эффективно разработать перспективный аппаратно-независимый пилотажный интерфейс, удовлетворяющий самым современным требованиям по эргономике.

В качестве инструмента разработки была выбрана система программирования Microsoft Visual Studio (VS). Вначале использовалась версия VS 2010, с которой начинается поддержка WPF 4.0, потом было принято решение перейти на VS 2013, так как в VS 2010 по умолчанию отсутствует поддержка интерактивной подсказки при наборе программного кода на С++, что существенно усложняло разработку.

Использование С++ вместе с С# в одном программном решении связано, в первую очередь, с отсутствием эффективно подключаемой реализации графической библиотеки DirectX 9 на С#, к тому же SDK (Software Development Kit – комплект средств разработки) производства ООО «РАСТР ТЕХНОЛОДЖИ» [7] полноценно поддерживает пока только языки С/С++ и Pascal/Delphi. Выбор DirectX обусловлен его полной совместимостью с WPF, в отличие от другой распространённой и используемой ранее библиотеки OpenGL. Неполная совместимость OpenGL и WPF сказывается, в первую очередь, на невозможности отображения и взаимодействия с элементами интерфейса поверх того элемента, куда выводится OpenGL-графика.

Взаимодействие WPF и DirectX 9 реализовано по стандартному шаблону взаимодействия, представленному на официальном справочном сайте MSDN (Microsoft Development Network), посвящённом платформе .NET [8, 9].

Таким образом, общее программное решение состоит из двух проектов: первый – ведущий, оконное WPF-приложение на языках XAML (стили и разметка интерфейса) и С# (управление интерфейсом и взаимодействие с остальными модулями), второй – ведомый DLL-проект, собирается как динамически подключаемая библиотека (Dynamic Link Library) на С++ с использованием DirectX 9 SDK и Raster Technology SDK v2.xx.

К ведомому проекту подключаются подпрограммы для видеокарты – пиксельные шейдеры, принимающие на вход и обрабатывающие текстуры изображений, поступающих от МСУВ, компиляция которых происходит в начале исполнения программы. Применение пиксельных шейдеров для обработки изображений, как наиболее вычислительно ёмких процедур, позволяет их обрабатывать в реальном масштабе времени (не менее чем с частотой получения информации от аппаратуры МСУВ – 25 Гц) на персональном и бортовом компьютере. Однако ставка на ключевую роль видеокарты при обработке данных накладывает определённые требования на её вычислительную мощность: желательно использование дискретной видеокарты не слабее, чем GeForce 330M [10], что аппаратно поддерживается далеко не всеми бортовыми компьютерами для авиационного применения.

Для DirectX 9 в текущей реализации используется версия пиксельных шейдеров 2_а, так как остальные поддерживаемые версии, начиная от 1.1 и заканчивая 3.0 [11], показали меньшую стабильность и производительность. В дальнейшем планируется перейти на более новую версию графического SDK, например, на DirectX 12, где существенно расширены и лучше оптимизированы наборы инструкций для современных моделей видеокарт.

Заключение

В ближайшее время планируется добавить в ПО RT-700Combo функции автоматического выбора наиболее информативных видеоканалов, их попиксельного совмещения и комплексирования в единое мультиспектральное изображение форматом 1280 × 960.

Литература

- E2VS Displays Potential as Breakthrough Product. Aviation Week Network. October 2015.

- Бондаренко М.А., Дрынкин В.Н. Оценка информативности комбинированных изображений в мультиспектральных системах технического зрения. Программные системы и вычислительные методы. 2016. №1.

- Бондаренко М.А., Дрынкин В.Н., Набоков С.А., Павлов Ю.В. Адаптивный алгоритм выбора информативных видеоканалов в бортовых многозональных системах усиленного видения. Сборник тезисов докладов Юбилейной Всероссийской научно-технической конференции «Авиационные системы в XXI веке». М. ФГУП «ГосНИИАС». 2016.

- Дрынкин В.Н., Фальков Э.Я., Царёва Т.И. Формирование комбинированного изображения в двухзональной бортовой авиационно-космической системе. Сборник трудов конференции ТЗСУ-2012. М. ИКИ РАН. 2012.

- Бондаренко А.В., Докучаев И.В., Ядчук К.А., Бондаренко М.А., Дрынкин В.Н. Пространственно-временная фильтрация движущихся изображений. Техническое зрение. 2014. Вып. 1(5).

- Платформа .NET. www.ru.wikipedia.org/wiki/.NET_Framework.

- Интерфейс динамических библиотек управления видеопроцессорами и цифровыми камерами RTxxxVP и RTxxxDC. www.rastr.net/Download/Doc/RTxxxDLL.pdf.

- Пошаговое руководство. Создание содержимого Direct3D9 для размещения в WPF. www.msdn.microsoft.com/ru-ru/library/cc656716(v=vs.110).aspx.

- Пошаговое руководство. Размещение содержимого Direct3D9 в WPF. www.msdn.microsoft.com/ru-ru/library/cc656785(v=vs.110).aspx.

- Видеокарта NVIDIA GeForce GT 330M. www.nvidia.ru/object/product_geforce_gt_330m_ru.html.

- Графическая библиотека DirectX. www.ru.wikipedia.org/wiki/DirectX.

Если вам понравился материал, кликните значок — вы поможете нам узнать, каким статьям и новостям следует отдавать предпочтение. Если вы хотите обсудить материал —не стесняйтесь оставлять свои комментарии : возможно, они будут полезны другим нашим читателям!