Флагманская модель DeepSeek V4-Pro достигает масштаба 1,6 трлн параметров, однако ключевой особенностью остаётся архитектура mix-of-experts: в каждый момент времени активны лишь 49 млрд параметров. Более компактная версия Flash использует 284 млрд параметров с активными 13 млрд — подход, который позволяет существенно снизить вычислительные затраты без критической потери качества.

Главный технологический сдвиг связан с переработкой механизма внимания. DeepSeek внедрила гибридную схему, объединяющую сжатое разрежённое внимание и heavy compressed attention. Это решение напрямую снижает нагрузку на KV-кэши — один из самых ресурсоёмких компонентов современных LLM. В результате модели способны поддерживать контекст до миллиона токенов, используя в 9,5–13,7 раза меньше памяти по сравнению с предыдущим поколением.

Дополнительный выигрыш даёт агрессивная квантизация. Если V3 уже использовала формат FP8, то V4 переходит к комбинации FP8 и FP4. Последний фактически вдвое снижает требования к памяти по сравнению с FP8, что делает возможным запуск сложных моделей на менее мощном оборудовании. Именно отсюда возникает метафора про «тостер»: речь идёт не о бытовых устройствах, а о возможности эффективно работать на относительно доступных AI-ускорителях, включая альтернативы GPU.

В аппаратной части DeepSeek демонстрирует прагматичный подход. Модель подтверждена для работы как на решениях Nvidia, так и на линейке Ascend от Huawei. Это особенно важно на фоне ограничений поставок передовых GPU в Китай: оптимизация под разные архитектуры снижает зависимость от одного поставщика и открывает путь к более дешёвому масштабированию.

Экономика — ещё один ключевой фактор. DeepSeek предлагает доступ к API по существенно более низким ценам: от $0,14 за миллион входных токенов для компактной версии до $1,74 для Pro, что заметно ниже тарифов западных провайдеров, включая OpenAI. Такая ценовая политика может усилить давление на рынок и ускорить commoditization LLM-инференса.

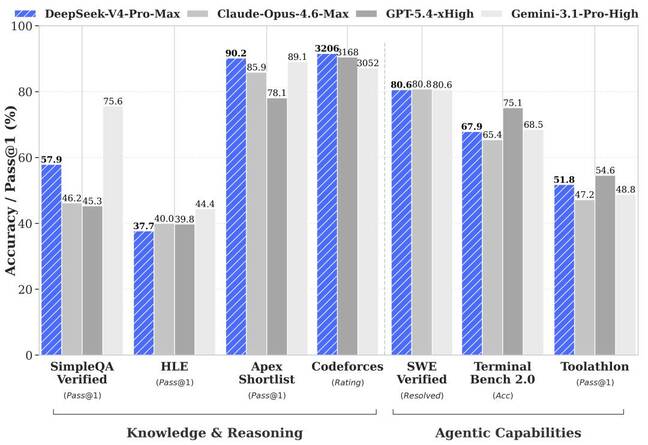

Несмотря на впечатляющие бенчмарки и заявления о сопоставимости с лучшими проприетарными моделями, остаётся открытым вопрос реальной производительности в продакшене. История показывает, что синтетические тесты не всегда отражают поведение моделей в сложных сценариях. Тем не менее, направление очевидно: DeepSeek делает ставку на эффективность как главный фактор конкуренции.

Если заявленные характеристики подтвердятся на практике, индустрия может перейти в новую фазу, где решающим станет не столько максимальный интеллект модели, сколько стоимость и доступность её использования.

Источник: https://www.theregister.com/2026/04/24/deepseek_v4/

Если вам понравился материал, кликните значок — вы поможете нам узнать, каким статьям и новостям следует отдавать предпочтение. Если вы хотите обсудить материал —не стесняйтесь оставлять свои комментарии : возможно, они будут полезны другим нашим читателям!