ИИ как новый инструмент вербовки и дезинформации

По данным разведывательных аналитиков, ИГ и другие радикальные структуры начали использовать генеративный ИИ практически сразу после публичного релиза ChatGPT. На профильных форумах, связанных с экстремистской идеологией, сторонников открыто призывают внедрять ИИ в повседневную деятельность групп.

Особый интерес представляют:

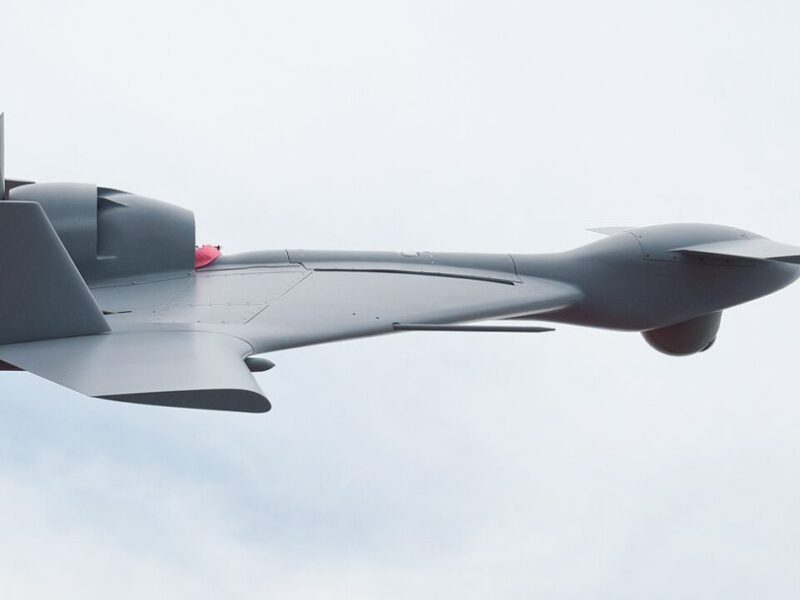

- создание реалистичных дипфейковых изображений и видео;

- автоматизированный перевод пропагандистских материалов на десятки языков;

- генерация аудиодипфейков с «речами» лидеров группировок.

Эксперты отмечают, что ИГ ещё задолго до появления ИИ одной из первых экстремистских организаций осознала потенциал социальных сетей как инструмента массовой вербовки и дезинформации. Использование ИИ стало логичным продолжением этой стратегии.

Масштабирование пропаганды и психологического давления

Даже слабо связанные между собой ячейки или одиночные радикалы, имеющие доступ к интернету, могут с помощью ИИ значительно расширить охват аудитории. Алгоритмы соцсетей усиливают эффект, продвигая эмоционально заряженный визуальный контент.

Так, во время конфликта между Израилем и ХАМАС в сети распространялись сгенерированные ИИ изображения, изображающие сцены насилия над детьми. Аналитики отмечают, что подобные материалы:

- усиливают поляризацию;

- провоцируют всплески ненависти;

- маскируют реальные события, подменяя их фейковыми образами.

Похожие методы применялись и после нападения на концертную площадку в России, ответственность за которое взяла на себя аффилированная с ИГ структура: в соцсетях и на форумах активно распространялись ИИ-видеоролики с пропагандистским содержанием.

Киберугрозы и опасения вокруг ОМУ

По словам Джона Лалиберте, бывшего исследователя уязвимостей в Агентство национальной безопасности, ныне главы компании ClearVector, ИИ существенно снижает порог входа для сложных операций:

«Даже небольшая группа с ограниченными ресурсами способна с помощью ИИ оказать непропорционально большое влияние».

Речь идёт не только о пропаганде. Хакерские группировки уже применяют синтетическое аудио и видео для фишинговых атак, выдавая себя за руководителей компаний или чиновников. Генеративный ИИ также используется для:

- написания вредоносного кода;

- автоматизации этапов кибератак;

- анализа уязвимостей.

Наибольшую обеспокоенность вызывает потенциальная возможность использования ИИ для разработки химического или биологического оружия, компенсируя недостаток профильной экспертизы. Этот сценарий включён в обновлённую оценку угроз, подготовленную Министерство внутренней безопасности США.

Реакция законодателей США

Американские законодатели признают необходимость срочных мер. Сенатор Марк Уорнер, ведущий демократ в Комитете Сената по разведке, заявил о важности упрощения обмена данными между разработчиками ИИ и государством — в части выявления злоупотреблений со стороны экстремистов, киберпреступников и иностранных спецслужб.

Во время слушаний в Палате представителей стало известно, что ИГ и «Аль-Каида»* проводят обучающие семинары, обучая сторонников работе с ИИ-инструментами.

Принятый в прошлом месяце закон обязывает службы внутренней безопасности ежегодно оценивать риски, связанные с применением ИИ экстремистскими организациями. По словам конгрессмена Августа Пфлюгера, инициатора законопроекта:

«Наши политики и возможности должны идти в ногу с угрозами завтрашнего дня».

Источник: https://abcnews.go.com/Technology/wireStory/militant-groups-experimenting-ai-risks-expected-grow-128...Если вам понравился материал, кликните значок — вы поможете нам узнать, каким статьям и новостям следует отдавать предпочтение. Если вы хотите обсудить материал —не стесняйтесь оставлять свои комментарии : возможно, они будут полезны другим нашим читателям!