Как менялись ожидания

До появления LLM, эксперты ИИ в среднем предсказывали достижение AGI к 2060 году. Но с выходом передовых моделей на основе трансформеров временная шкала резко сдвинулась:

- Исследователи теперь чаще называют 2040 год.

- Предприниматели склоняются к 2030 году.

- Некоторые радикальные оценки указывают на ближайшие 6–12 месяцев как потенциальный период прорыва.

Почему ожидания сдвинулись

Авторы макроанализа выделяют несколько ключевых факторов:

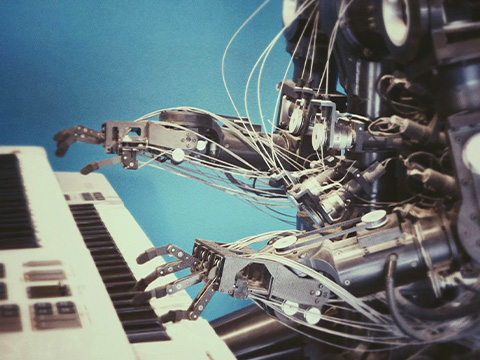

- Отсутствие чётких пределов роста ИИ: В отличие от человеческого интеллекта, машинный интеллект развивается без явно выраженных когнитивных барьеров.

- Экспоненциальный рост вычислительной мощности, включая возможную роль квантовых вычислений в обход физических ограничений кремниевых чипов.

- Способность ИИ ускорять собственное развитие, автоматически оптимизируя эксперименты, обучение и исследовательские процессы.

Опасения и надежды

Сторонники ИИ-сингулярности утверждают, что более "умные" ИИ смогут быстро продвинуть науку, в том числе в лечении заболеваний. Однако сами по себе данные и мощность ещё не гарантируют прорывов:

«Даже самая мощная система может не найти лекарство от рака, если будет анализировать только то, что уже известно», — говорится в отчёте.

Одновременно растут опасения относительно управляемости, этики и социального влияния AGI. Некоторые эксперты считают, что масштаб и последствия такого технологического сдвига будут сравнимы с биологической эволюцией.

Вывод:

Согласно новому анализу, научное сообщество всё чаще склоняется к мысли, что сингулярность не просто возможна — она, возможно, уже близка. Но каким будет её результат — эволюционным скачком или экзистенциальным риском — зависит от того, как человечество подготовится к этой трансформации.

Если вам понравился материал, кликните значок - вы поможете нам узнать, каким статьям и новостям следует отдавать предпочтение. Если вы хотите обсудить материал - не стесняйтесь оставлять свои комментарии : возможно, они будут полезны другим нашим читателям!